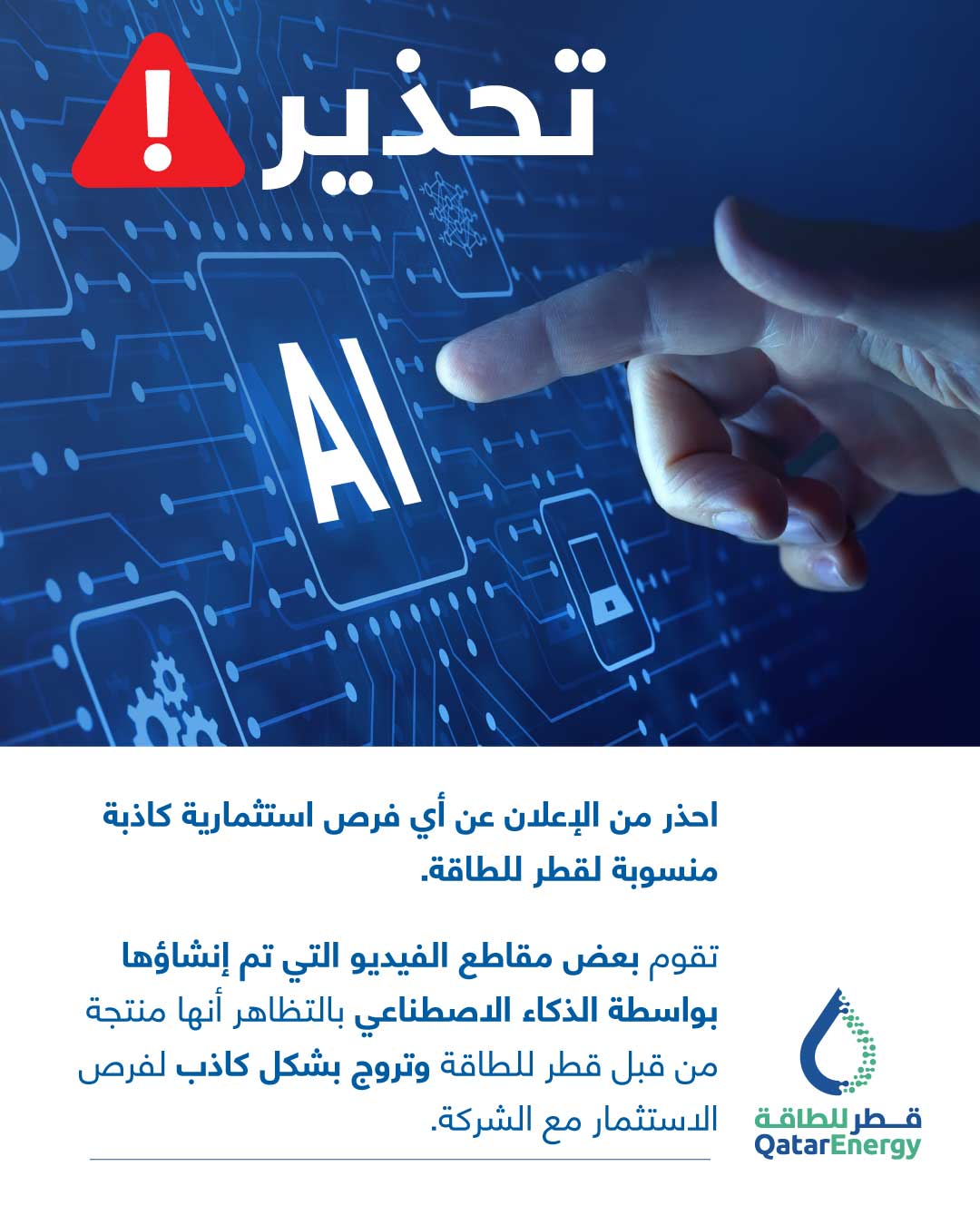

شهدت السنوات الأخيرة تطورًا كبيرًا في تقنيات الذكاء الاصطناعي، مما ساهم في تحسين العديد من المجالات، لكنه في الوقت ذاته أصبح أداة تُستخدم في عمليات الاحتيال الإلكتروني. ومن بين أبرز الجهات التي تعرضت لمحاولات الاحتيال باستخدام الذكاء الاصطناعي. شركة قطر للطاقة تحذر من الاحتيال، والتي أصدرت تحذيرًا رسميًا بشأن مقاطع فيديو احتيالية تم إنشاؤها عبر الذكاء الاصطناعي وتنتحل هويتها.

قطر للطاقة تحذر من الاحتيال

أصدرت قطر للطاقة بيانًا رسميًا تحذر فيه من استخدام اسمها في إعلانات احتيالية مزيفة يتم الترويج لها عبر الإنترنت. وأكدت الشركة أن بعض مقاطع الفيديو التي تم إنشاؤها بواسطة الذكاء الاصطناعي تزعم بشكل خاطئ أنها مواد رسمية من إنتاج قطر للطاقة، وتستخدم للإيقاع بالمستثمرين عبر الترويج لاستثمارات غير حقيقية.

وأكدت الشركة أنها لا تطلب أبدًا أموالًا من الجمهور، لا بشكل مباشر ولا غير مباشر، محذرة من الوقوع في فخ هذه العروض الاستثمارية الوهمية. كما شددت على أهمية التحقق من أي معلومات يتم نشرها عبر الإنترنت، وعدم الانجرار وراء الإعلانات التي تعد بعوائد مالية مغرية دون أساس واقعي.

كيف يتم الاحتيال باستخدام الذكاء الاصطناعي؟

الذكاء الاصطناعي، وخاصة تقنية التزييف العميق (Deepfake)، أصبح أداة خطيرة في يد المحتالين. من خلال هذه التقنية، يمكن إنشاء مقاطع فيديو مزيفة لشخصيات مشهورة أو مسؤولي شركات كبرى، مما يجعل المحتوى يبدو حقيقيًا ومقنعًا.

في حالات الاحتيال المالي، يستخدم المحتالون هذه التقنيات لإنشاء مقاطع فيديو تبدو وكأنها صادرة عن شخصيات مرموقة في عالم المال والأعمال، حيث يدعون أنهم يقدمون فرصًا استثمارية حصرية ومضمونة. هذا الأسلوب يجعل الضحية أكثر عرضة للانخداع، خاصة عندما يرى شخصًا يثق به يروج للاستثمار.

تزايد حالات الاحتيال عالميًا

ليست قطر للطاقة الشركة الوحيدة التي تعرضت لهذا النوع من الاحتيال. ففي العديد من الدول، انتشرت حالات مماثلة حيث يتم استخدام مقاطع الفيديو المزيفة لخداع المستثمرين. على سبيل المثال:

– في الولايات المتحدة، أصدرت المدعية العامة لنيويورك، ليتيتيا جيمس، تحذيرًا بشأن ارتفاع حالات الاحتيال المالي التي تعتمد على الذكاء الاصطناعي.

– في أوروبا، أبلغت بعض المؤسسات المالية عن محاولات احتيال شبيهة باستخدام تقنيات الذكاء الاصطناعي.

– في دول الخليج، تم رصد حملات احتيالية تروج لاستثمارات غير مشروعة عبر الإنترنت.

كيف تحمي نفسك من الاحتيال؟

لمواجهة هذه التهديدات المتزايدة، هناك عدة خطوات يمكن اتخاذها لحماية الأفراد والشركات من الوقوع ضحية لهذه الأساليب الاحتيالية:

1. التحقق من المصدر:يجب التأكد من صحة المعلومات الواردة في الإعلانات أو مقاطع الفيديو من خلال الرجوع إلى الموقع الرسمي للشركة المعنية.

2. تجنب العروض المغرية: أي عرض استثماري يعد بعوائد مضمونة وسريعة هو على الأرجح عملية احتيال.

3. عدم مشاركة المعلومات الشخصية أو المالية: لا يجب مشاركة أي بيانات حساسة عبر الإنترنت دون التأكد من الجهة التي تطلبها.

4. الإبلاغ عن الأنشطة المشبوهة: عند الشك في إعلان معين، يجب الإبلاغ عنه إلى الجهات المختصة حتى يتم التحقيق في الأمر.

5. استخدام برامج الحماية: بعض البرامج والتطبيقات المتخصصة يمكنها الكشف عن المحتوى المزيف الذي يتم إنشاؤه باستخدام الذكاء الاصطناعي.

دور الحكومات والشركات في التصدي للاحتيال

مع تزايد هذه التهديدات، أصبح من الضروري أن تتخذ الحكومات والمؤسسات إجراءات حازمة لمكافحة الاحتيال باستخدام الذكاء الاصطناعي. تشمل بعض هذه الجهود:

– تشديد القوانين: العمل على إصدار قوانين صارمة لمحاسبة الجهات التي تستخدم الذكاء الاصطناعي في عمليات الاحتيال.

– زيادة الوعي: إطلاق حملات توعوية تهدف إلى تثقيف الجمهور حول كيفية التعرف على المحتوى الاحتيالي.

– تطوير تقنيات الحماية: الاستثمار في تقنيات متقدمة تساعد في كشف المحتوى المزيف قبل انتشاره.

بات الاحتيال باستخدام الذكاء الاصطناعي يشكل تهديدًا حقيقيًا للشركات والمستثمرين، حيث يستغل المحتالون التكنولوجيا المتقدمة لخداع الضحايا. وجاء تحذير قطر للطاقة ليؤكد خطورة هذه الظاهرة، مما يتطلب من الجميع توخي الحذر واتخاذ التدابير اللازمة لحماية أنفسهم من عمليات الاحتيال.

يجب عليك تسجيل الدخول لكتابة تعليق.